ChatGPT und Google Bard – Prompt – Sammlung

Prompt-Hilfen und -Sammlungen

- PromptPerfect Werkzeug für das Prompt Engineering

- Promptbase Prompts aller Art, aslo auch für Bilderdienste

- Brex’s Prompt Engineering Guide Ausführliche Anleitung

- Awesome ChatGPT Prompts Prompts für Rollen

- Besser prompten: Gib der KI gut strukturierte ROMANE! Dann gibt sie dir auch die richtigen Antworten. Blogbeitrag, der das ROMANE-Schema erklärt

- Text Blaze Snippet-Verwaltung für Chrome

- Prompt Box Prompt-Verwaltung für KI

- OpenAI Playground

Sonstige Tools

Schreibe eine einfache Einleitung für: Title: [NameTheme] Zielgruppe: [Targ] Aufgabe: Erzeuge Aufmerksamkeit im Leser und fordere sie auf, mit dem Inhalt zu interagieren

44 Google Bard-Beispielaufforderungen zur Suchmaschinenoptimierung (SEO)

Hier sind 44 Beispielaufforderungen zur Anleitung und Verbesserung der SEO-Arbeit mit Google Bard. Ersetzen Sie den Text in [ eckigen Klammern ] durch Ihre relevanten Schlüsselwörter/Website-URL/Thema, wie in den Eingabeaufforderungen angegeben.

Bitte beachten Sie auch, dass einige Eingabeaufforderungen, die URLs verwenden, bei einigen Websites mit geringerem Inhalt funktionieren.

- Schlüsselwörter generieren: „Suchen Sie relevante Schlüsselwörter für das Website-Thema [ Website-Thema einfügen ]“

- Long-Tail-Keywords auswählen: „Long-Tail-Keyword-Vorschläge für [ Hauptschlüsselwort einfügen ] bereitstellen“

- Keyword-Schwierigkeitsgrad: „Analysieren Sie den Keyword-Schwierigkeitsgrad für die Liste: [ Liste mit Keywords einfügen ]“

- Konkurrenten ausspionieren: „Identifizieren Sie die fünf besten Konkurrenten für das Ziel-Keyword [ Ziel-Keyword einfügen ]“

- Backlink-Analyse: „Entdecken Sie hochwertige Backlink-Möglichkeiten für meine Website [ geben Sie Ihre Website-URL ein ]“

- On-Page-SEO-Analyse: „Führen Sie eine On-Page-SEO-Analyse durch für [ geben Sie Ihre Website-URL ein ] “

- Titel-Tag-Optimierung: „Titel-Tag für Ziel-Keyword optimieren [ Ziel-Keyword einfügen ]“

- Optimierung der Meta-Beschreibung: „Schreiben Sie eine überzeugende Meta-Beschreibung für das Ziel-Keyword [ Ziel-Keyword einfügen ]“

- Header-Tag-Optimierung: „H2- und H3-Überschriften für Ziel-Keyword vorschlagen [ Ziel-Keyword einfügen ]“

- Bildoptimierung: „Geben Sie Tipps zur Bildoptimierung für [ Website-Thema einfügen ]“

- Inhaltsoptimierung: „Machen Sie umsetzbare Vorschläge, wie Sie den Inhalt von [ Website-URL einfügen ] für SEO verbessern können.“

- Generieren Sie Blog-Themen: „Listen Sie 10 ansprechende Blog-Post-Ideen zum Thema [ Thema einfügen ] auf.“

- Schreiben Sie eine Einleitung: „Verfassen Sie einen ansprechenden Einleitungsabsatz für einen Blogbeitrag zum Thema [ Thema des Blogbeitrags einfügen ].“

- Erstellen Sie eine Gliederung: „Entwerfen Sie eine gut strukturierte Gliederung für einen Blogbeitrag über [ Blogbeitragsthema einfügen ]“

- Generieren Sie FAQs: „Überlegen Sie sich 5 häufig gestellte Fragen und Antworten zu [Thema einfügen ]“

- Kuratierung von Inhalten: „Finden Sie wertvolle Inhaltsquellen in [ Nischenbranche einfügen ]“

- Interne Linkanalyse: „Analysieren Sie die interne Linkstruktur für [ Webseiten-URL einfügen ]“

- Inhaltslückenanalyse: „Führen Sie eine Inhaltslückenanalyse zwischen [ geben Sie Ihre Website-URL ein ] und den Top-Konkurrenten durch.“

- Externer Linkaufbau: „Schlagen Sie 10 externe Linkaufbaumethoden für [ Website-Nische einfügen ] vor“

- Lokales SEO-Audit: „Führen Sie ein lokales SEO-Audit für mein Unternehmen durch [ Webseiten-URL einfügen ]“

- Mobilfreundlichkeit: „Bestimmen Sie die Mobilfreundlichkeit von [ Webseiten-URL einfügen ]“

- Seitengeschwindigkeitsanalyse: „Analysieren Sie die Seitengeschwindigkeit von [ Webseiten-URL einfügen ] und geben Sie Optimierungsempfehlungen.“

- SSL-Prüfung: „Untersuchen Sie das SSL-Zertifikat auf [ Webseiten-URL einfügen ““

- Erkennung doppelter Inhalte: „Identifizieren Sie Probleme mit doppelten Inhalten auf [ Webseiten-URL einfügen ]“

- Kanonisierung: „Überprüfen Sie die Kanonisierungseinrichtung für [ Webseiten-URL einfügen ]“

- Analyse der Website-Struktur: „Bewertung und Verbesserungsvorschläge für die Website-Struktur von [ Webseiten-URL einfügen ]“

- Optimierung der URL-Struktur: „Geben Sie Tipps zur Optimierung der URL-Struktur für [ Webseiten-URL einfügen ]“

- Verbesserung des Navigationsmenüs: „Verbesserungen für das Navigationsmenü von [ Webseiten-URL einfügen ] vorschlagen“

- Schema-Markup-Vorschlag: „Empfehlen Sie geeignete Schema-Markups für [ Website-Nische einfügen ]“

- Targeting auf hervorgehobene Snippets: „Identifizieren Sie mögliche Möglichkeiten für hervorgehobene Snippets für [ Keyword-Liste einfügen ]“

- Optimierung der Sprachsuche: „Bieten Sie Tipps zur Optimierung der Sprachsuche für [ Website-Thema einfügen ]“

- Video-SEO-Strategie: „Schlagen Sie eine Video-SEO-Strategie für [ Website-Nische einfügen ] vor“

- Podcast-SEO-Empfehlungen: „SEO-Empfehlungen für Podcast bereitstellen [Podcast-Namen einfügen ]“

- Empfehlungen für SEO-Tools: „Empfehlen Sie die 5 besten SEO-Tools, die für [ Unternehmenstyp einfügen ] geeignet sind.“

- SEO-KPI-Tracking: „Schlagen Sie wesentliche SEO-KPIs zur Verfolgung vor [ Website-Nische einfügen ]“

- Tipps zur SEO-Fortschrittsüberwachung: „Stellen Sie effektive Methoden zur Überwachung des SEO-Fortschritts bereit.“

- Überwachen Sie Aktualisierungen des Google-Algorithmus: „Benachrichtigen Sie mich über aktuelle Aktualisierungen des Google-Algorithmus und mögliche Auswirkungen.“

- Analysieren Sie die SEO-Strategien der Wettbewerber: „SEO-Strategien der Wettbewerber überprüfen [ Konkurrenzliste einfügen ]“

- Überwachen Sie SERP-Änderungen: „Verfolgen Sie SERP-Positionsänderungen für [ Liste mit Schlüsselwörtern einfügen ]“

- Bewerten Sie den organischen Suchverkehr: „Analysieren Sie die Datenmuster der organischen Suche für [ Website-URL einfügen ]“

- Ausführliches technisches SEO-Audit: „Führen Sie ein umfassendes technisches SEO-Audit für [ Webseiten-URL einfügen ] durch .“

- Strafbewertung: „Überprüfen Sie, ob Google-Strafen für [ Webseiten-URL einfügen ] vorliegen.“

- SEO-Strategieoptimierung: „Empfehlen Sie Optimierungstipps für meine aktuelle SEO-Strategie.“

- SEO-Erfolgsmessung: „Unterstützung bei der Definition und Messung des SEO-Erfolgs für [ Website-Nische einfügen ]“

Durch die Nutzung dieser Google Bard-Eingabeaufforderungen können SEO-Bemühungen fundierter, effizienter und effektiver werden, die Sichtbarkeit erhöhen und den organischen Traffic steigern.

Wenn Sie weitere nützliche SEO-Anregungen haben, kommentieren Sie diese bitte unten.

Google Bard Prompts Archives – Prompt Shouter

Konkrete Prompts für das Marketing mit Beispielen und Use Cases

Im Folgenden finden Sie eine Auswahl konkreter Prompts, die im Marketing genutzt werden können. Jeder Prompt wird von einem Beispiel begleitet, das verdeutlicht, wie er in der Praxis angewendet werden kann.

- Prompt: Erstellen Sie einen überzeugenden Werbetext für ein neues Produkt.Beispiel: „Entdecken Sie die Zukunft des Kaffeegenusses mit unserem revolutionären Smart Coffee Maker! Perfektionieren Sie Ihren Morgen mit nur einem Knopfdruck und genießen Sie den aromatischen Geschmack von frisch gebrühtem Kaffee, der genau nach Ihrem Geschmack zubereitet wird. Starten Sie in den Tag mit einer Tasse Kaffee, die auf Sie zugeschnitten ist.“Use Case: Dieser Prompt eignet sich ideal für die Erstellung von Werbetexten für neue Produkte. Mit ChatGPT können Sie ansprechende und überzeugende Beschreibungen erstellen, die das Interesse potenzieller Kunden wecken und sie dazu ermutigen, das Produkt auszuprobieren.

- Prompt: Entwickeln Sie eine Social-Media-Kampagne, um die Markenbekanntheit zu steigern.Beispiel: „Gehen Sie mit uns auf eine Reise durch die Welt der Mode! Verfolgen Sie unsere Instagram Stories, um exklusive Einblicke in die neuesten Modetrends zu erhalten, inspirierende Outfit-Ideen zu entdecken und an aufregenden Gewinnspielen teilzunehmen. Werden Sie Teil unserer Community und lassen Sie sich von der Mode verzaubern!“Use Case: Dieser Prompt eignet sich hervorragend für die Entwicklung von Social-Media-Kampagnen. ChatGPT kann Ihnen helfen, ansprechende Texte für Posts, Stories und Anzeigen zu erstellen, die die Aufmerksamkeit der Zielgruppe auf sich ziehen und die Markenbekanntheit steigern.

- Prompt: Schreiben Sie eine E-Mail, um potenzielle Kunden von Ihrem Produkt zu überzeugen.Beispiel: „Sehr geehrte/r [Name], haben Sie schon einmal davon geträumt, Ihr Zuhause in eine Oase der Entspannung zu verwandeln? Mit unserem neuen Smart Home System wird dieser Traum Wirklichkeit. Steuern Sie Ihre Beleuchtung, Heizung und Sicherheitssysteme mit nur einem Klick und erleben Sie ultimative Bequemlichkeit und Sicherheit. Fordern Sie noch heute eine kostenlose Produktpräsentation an und lassen Sie sich von den Möglichkeiten begeistern.“Use Case: Dieser Prompt ist perfekt für die Erstellung überzeugender E-Mails, um potenzielle Kunden anzusprechen. ChatGPT kann Ihnen dabei helfen, die Vorteile Ihres Produkts hervorzuheben und Ihre Zielgruppe von dessen Wert und Nutzen zu überzeugen.

- Prompt: Verfassen Sie einen Blogbeitrag, der Ihr Fachwissen auf Ihrem Gebiet demonstriert.Beispiel: „Die ultimative Anleitung zur Suchmaschinenoptimierung: 10 bewährte Strategien für mehr Sichtbarkeit im Web. Erfahren Sie, wie Sie Ihre Website für Suchmaschinen optimieren können, um mehr organischen Traffic zu generieren und Ihre Online-Präsenz zu stärken. Entdecken Sie die neuesten Trends, bewährte Techniken und praktische Tipps, um in den Suchergebnissen ganz nach oben zu klettern.“Use Case: Dieser Prompt eignet sich ideal für die Erstellung von informativen Blogbeiträgen. Mit ChatGPT können Sie Inhalte erstellen, die Ihr Fachwissen und Ihre Autorität auf Ihrem Gebiet demonstrieren und gleichzeitig wertvolle Informationen und Tipps für Ihre Leser liefern.

Textarbeiter

ChatGPT eignet sich hervorragend, um bereits vorhandenes Textmaterial zu überarbeiten. Sie haben einen verschwurbelten, kaum verständlichen Text, mit einem Irrgarten an Nebensätzen? Dann geben Sie ihn ChatGPT, etwa in der Form:

Hier ist ein Text: [Hier der komplette Text]

Formuliere mir diesen Text leicht verständlich um.

In ähnlicher Weise kann ChatGPT auch Texte zusammenfassen oder in Stichpunkten strukturieren.

Ein sehr mächtiges Werkzeug ist es, ChatGPT einen bestimmten Stil oder eine bestimmte Rolle

zuzuweisen. Manchmal muss man ein wenig experimentieren oder zusätzliche Hinweise in Form von Beispielen geben. Oder Sie lassen ChatGPT die Beispiele gleich selbst liefern:

Erkläre mir Quantenmechanik im Stil von Mario Barth

etwa ergab einen eher spröden Vergleich von Mario Barth mit der Quantenmechanik.

Auf

Wie funktioniert Quantenmechanik? Erkläre es mir im Stile von Mario Barth. Bau seine Phrasen wie „verstehste?“ ein

baute ChatGPT nur „verstehste“ ein. Erst als wir ChatGPT fragten

Welche typischen Phrasen verwendet Mario Barth?

und anschließend anwiesen,

Gib mir nochmal eine Erklärung der Quantenmechanik, bei der du mehr von den Phrasen einbaust

generierte ChatGPT eine Antwort im Stil des Comedian

- ChatGPT-Homepage

- API keys … für den Zugriff auf das OpenAI-API generieren

Prompt-Sammlungen und Nutzungsbeispiele

- FlowGPT Prompt-Community

- ShareGPT Prompt-Sammlung

- Awesome ChatGPT Prompts Prompt-Sammlung

- ChatGPT Cheat Sheet (PDF)

- Learn Prompting Prompts auch für Bilderdienste

- 20 Experimente mit ChatGPT: Der universalgelehrte Depp

- 20 Entertaining Uses of ChatGPT You Never Knew Were Possible

ChatGPT-Fails

Browser-Erweiterungen und Apps

- ChatGPT Desktop App

- WebChatGPT

- ChatGPT Prompt Genius

- Merlin

- Luna

- Awesome ChatGPT Den Chatbot über die verschiedensten Kanäle nutzen: Siri, Telegram, mac-os-Menü, Slack, etc.

Wer den Browser bevorzugt, der kann mit diversen Add-ons den Funktionsumfang des Chatbots

erweitern und ihn jederzeit im Browser aufrufen, ohne Umweg über die OpenAI-Website. Alle im Folgenden vorgestellten Browser-Erweiterungen sind kostenlos. Sie sind für Chromium-Browser (Chrome, Edge, Vivaldi, Brave, etc.) und Firefox verfügbar, sofern nicht anders angegeben.

WebChatGPT ergänzt das Eingabefeld von ChatGPT um einen Schalter „Search on the web“. Wenn aktiviert, verwendet die Erweiterung die Ergebnisse einer Suchmaschine, um die Eingabeaufforderung umzuschreiben. Zunächst listet es dafür eine Reihe von Suchergebnissen inklusive der Textsnippets und Quellen auf (dabei ist allerdings nicht klar, welche Suchmaschine es nutzt). Dann fordert es ChatGPT auf:

Instructions: Using the provided web search results, write a comprehensive reply to the given prompt. Make sure to cite results using [number] notation after the reference. If the provided search

results refer to multiple subjects with the same name, write separate answers for each subject.

Prompt:

So kann ChatGPT auch Antworten zu aktuellen Ereignissen liefern – inklusive der Quellen, auf die

er sich dabei stützt. Auch die Anzahl der verwendeten Suchergebnisse, die Zeit und die Region lassen sich einstellen. WebChatGPT ist nur für ChromiumBrowser verfügbar.

Auch was GPT-4 ausspuckt, ist nicht immer zu hundert Prozent korrekt. Aber wer die Fähigkeiten von ChatGPT erst einmal (ein-)schätzen gelernt hat, wird den Sprachbot nicht mehr missen wollen. Neben ChatGPT gibt es allerdings noch viele weitere mächtige Textwerkzeuge, die auf großen Sprachmodellen aufsetzen.

Text generieren

Prompt: write an intro paragraph to a mystery novel

Textarbeiter

ChatGPT eignet sich hervorragend, um bereits vorhandenes Textmaterial zu überarbeiten. Sie haben einen verschwurbelten, kaum verständlichen Text, mit einem Irrgarten an Nebensätzen? Dann geben Sie ihn ChatGPT, etwa in der Form:

Hier ist ein Text: [Hier der komplette Text]

Formuliere mir diesen Text leicht verständlich um.

In ähnlicher Weise kann ChatGPT auch Texte zusammenfassen oder in Stichpunkten strukturieren.

Ein sehr mächtiges Werkzeug ist es, ChatGPT einen bestimmten Stil oder eine bestimmte Rolle

zuzuweisen. Manchmal muss man ein wenig experimentieren oder zusätzliche Hinweise in Form von Beispielen geben. Oder Sie lassen ChatGPT die Beispiele gleich selbst liefern:

Erkläre mir Quantenmechanik im Stil von Mario Barth

etwa ergab einen eher spröden Vergleich von Mario Barth mit der Quantenmechanik.

Auf

Wie funktioniert Quantenmechanik? Erkläre es mir im Stile von Mario Barth. Bau seine Phrasen wie „verstehste?“ ein

baute ChatGPT nur „verstehste“ ein. Erst als wir ChatGPT fragten

Welche typischen Phrasen verwendet Mario Barth?

und anschließend anwiesen,

Gib mir nochmal eine Erklärung der Quantenmechanik, bei der du mehr von den Phrasen einbaust

generierte ChatGPT eine Antwort im Stil des Comedian

- ChatGPT-Homepage

- API keys … für den Zugriff auf das OpenAI-API generieren

Prompt-Sammlungen und Nutzungsbeispiele

- FlowGPT Prompt-Community

- ShareGPT Prompt-Sammlung

- Awesome ChatGPT Prompts Prompt-Sammlung

- ChatGPT Cheat Sheet (PDF)

- Learn Prompting Prompts auch für Bilderdienste

- 20 Experimente mit ChatGPT: Der universalgelehrte Depp

- 20 Entertaining Uses of ChatGPT You Never Knew Were Possible

ChatGPT-Fails

Browser-Erweiterungen und Apps

- ChatGPT Desktop App

- WebChatGPT

- ChatGPT Prompt Genius

- Merlin

- Luna

- Awesome ChatGPT Den Chatbot über die verschiedensten Kanäle nutzen: Siri, Telegram, mac-os-Menü, Slack, etc.

Wer den Browser bevorzugt, der kann mit diversen Add-ons den Funktionsumfang des Chatbots

erweitern und ihn jederzeit im Browser aufrufen, ohne Umweg über die OpenAI-Website. Alle im Folgenden vorgestellten Browser-Erweiterungen sind kostenlos. Sie sind für Chromium-Browser (Chrome, Edge, Vivaldi, Brave, etc.) und Firefox verfügbar, sofern nicht anders angegeben.

WebChatGPT ergänzt das Eingabefeld von ChatGPT um einen Schalter „Search on the web“. Wenn aktiviert, verwendet die Erweiterung die Ergebnisse einer Suchmaschine, um die Eingabeaufforderung umzuschreiben. Zunächst listet es dafür eine Reihe von Suchergebnissen inklusive der Textsnippets und Quellen auf (dabei ist allerdings nicht klar, welche Suchmaschine es nutzt). Dann fordert es ChatGPT auf:

Instructions: Using the provided web search results, write a comprehensive reply to the given prompt. Make sure to cite results using [number] notation after the reference. If the provided search

results refer to multiple subjects with the same name, write separate answers for each subject.

Prompt:

So kann ChatGPT auch Antworten zu aktuellen Ereignissen liefern – inklusive der Quellen, auf die

er sich dabei stützt. Auch die Anzahl der verwendeten Suchergebnisse, die Zeit und die Region lassen sich einstellen. WebChatGPT ist nur für ChromiumBrowser verfügbar.

Auch was GPT-4 ausspuckt, ist nicht immer zu hundert Prozent korrekt. Aber wer die Fähigkeiten von ChatGPT erst einmal (ein-)schätzen gelernt hat, wird den Sprachbot nicht mehr missen wollen. Neben ChatGPT gibt es allerdings noch viele weitere mächtige Textwerkzeuge, die auf großen Sprachmodellen aufsetzen.

Text generieren

Prompt: write an intro paragraph to a mystery novel

Du kannst dir Postideen für deinen nächsten Instagram-Beitrag erstellen lassen und musst nur noch eine Grafik wählen, deinen generierten Text draufsetzen und fertig.

Probier doch mal aus: „Schreibe mir 10 Instagram-Posts für Frauen, die mit Yoga beginnen wollen, aber Angst haben, nicht beweglich genug zu sein.“

→ Du kannst dir nun aus einem der Beiträge eine Gliederung für einen Blog-Beitrag erstellen lassen. Probiere aus: „Schreibe mir eine Gliederung für einen Blog-Beitrag, in dem ich den 3. Post aufgreifen möchte.“

Du kannst dir nun sogar von ChatGPT Keywords ausgeben lassen, für die es sich lohnt, diesen Beitrag zu optimieren. Probiere: „Welche Keywords eignen sich für diesen Beitrag? Wähle Keywords mit einfachem Ranking-Potenzial.“

Jetzt könntest du dir von ChatGPT einen Titel schreiben lassen, eine Einleitung, jeden einzelnen Abschnitt, suchmaschinenoptimierte Zwischenüberschriften und so weiter.

Geht das schneller, als würdest du dir das alles selbst überlegen?

JA, auf jeden Fall.

Klingt das alles gut, was ChatGPT so generiert?

JA, irgendwie schon.

Weißt du, ob die Antworten richtig sind? Ob die Keywords wirklich geeignet sind? Ob die Ideen zu dir und deiner Zielgruppe passen?

NEIN!

Und jetzt kommen wir zu meinem Anfangsgedanken und Aufruf.

ChatGPT wirkt verlockend und auch ich nutze es zur Inspiration oder für neue Anregungen. ABER vergiss nicht:

- ChatGPT kann nur ausgeben, was du eingibst.

- ChatGPT kennt deine Zielgruppe nicht wirklich.

- ChatGPT kennt dich nicht.

- ChatGPT kennt deine Arbeitsweise nicht.

- ChatGPT kennt deine Lieblingskund:innen nicht.

- ChatGPT kennt deine Werte nicht und was dich und dein Business wirklich ausmacht.

- ChatGPT kennt die Träume, Probleme und Wünsche deiner zukünftigen Kund:innen nicht.

Ja, ChatGPT kann dir Träume und Probleme deiner Zielgruppe ausgeben, aber lass dich nicht täuschen. ChatGPT ist eine KI, die aufgrund von vielen Daten Durchschnittswerte errechnet und ausgibt.

ChatGPT im Digital Marketing & SEO – Anwendungsmöglichkeiten und Risiken

ChatGPT in der SEO – Was sagt Google?

Schauen wir uns die Kritikpunkte zu ChatGTP an, so sticht einer besonders hervor: Googles Richtlinien für Webmaster. Dort wird folgendes beschrieben:

„Automatisch generierte Spaminhalte sind Inhalte, die durch ein Programm erstellt wurden, ohne dass dabei Originalinhalte oder ein ausreichender Mehrwert geschaffen wurde. Sie dienen hauptsächlich dazu, das Suchranking zu manipulieren – für Nutzer sind sie nicht hilfreich. […]“

Solltest du also komplette Seiten mit automatisch generierten Inhalten auf deiner Seite haben, kann es passieren, dass du von Google abgestraft wirst oder dass sich dein Ranking verschlechtert. Sicher nicht ohne Grund gab es im Jahr 2022 den Google Helpful Content Update.

Aktuell scheint es so, als wäre der Google Algorithmus noch nicht in der Lage, zielgenau automatisch generierte Texte zu erkennen und es gibt noch viele Websites, die mit KI-erzeugten Texten durchkommen. Trotzdem ist gerade Google ein Vorreiter in der Nutzung von Künstlicher Intelligenz und Deep Learning. Hier findest du 9 Ansätze wie Google KI für sich nutzt.

Mehr Interesse? Wir haben auch für dich ein ChatGPT Seminar mit Jens Polomski und ein ChatGPT SEO-Seminar mit Alexander Holl.

ChatGPT für die Texterstellung (Content)

6. Sätze umschreiben, um Wortwiederholungen zu vermeiden

Du hast einen Text mit vielen Wortdopplungen aber gerade nicht die Muße, diesen umzuschreiben? Lass es ChatGPT für dich erledigen

Beispiel: „Schreibe diesen Text um und vermeide dabei Wortdopplungen. Der Sinn des Inhalts soll beibehalten werden: [Hier Text einfügen]“

7. FAQs generieren

Finde die am häufigsten gefragten Fragen zu deinem Inhalt. Diese kannst du anschließend als FAQs verwenden.

Beispiel: „Erstelle eine Liste mit 3 häufig gestellten Fragen, basierend auf diesem Inhalt: [Text einfügen]“

8. Zusammenfassungen generieren

Genauso wie bei den FAQs kann ChatGPT dir dabei helfen, Zusammenfassungen von Inhalten zu erstellen.

Ein konkretes Anwendungsbeispiel wäre hier eine Follow-Up-E-Mail im Anschluss an ein Kundentelefonat: „Schreibe eine Mail, in der du dich für das heutige Telefonat bedankst und gehe darin außerdem auf die besprochenen Themen aus folgendem Protokoll ein: [Gesprächsprotokoll einfügen]“

9. Synonyme finden

Genau wie Synonyme. Woxikon kann ChatGPT verschiedene Synonyme für Begriffe identifizieren.

ChatGPT im Performance Marketing

10. A/B-Tests für responsive Suchanzeigen

Lasse dir mit ChatGPT Formulierungen für verschiedene Versionen einer RSA-Anzeige erstellen. Dabei kannst du für die einzelnen Anzeigen auch verschiedene Schwerpunkte setzen.

Beispiel: Erstelle zwei Google-Anzeigen im RSA-Format (mit je drei Überschriften und einer Beschreibung) für einen A/B-Test von „Schuhe von Adidas“. Erläutere, warum sich die Anzeigen für einen Test eignen würden.

11. Ideen für die Platzierung deiner Displayanzeigen

ChatGPT kann dir dabei helfen, bestimmte Seiten für deine Anzeigen im GND auszuwählen.

Beispiel: „Wenn ich Anzeigen für „Little Lunch“ im Google-Display-Netzwerk schalten würde, welche Arten von Websites und Kanälen sollte ich anvisieren.“

—

Ok, sagen wir besser zu begeistern! Stellt Euch vor, Ihr sitzt mit Eurer Zielgruppe in einem Raum und lest ihnen Eure Inhalte auf der Website vor. Welche Fragen entstehen? Welches Feedback könnt Ihr erwarten? Wie nützlich finden Eure Kund:innen tatsächlich diese Inhalte? Füllt die logischen, inhaltlichen Lücken und Eurer weiteren Content- und SEO-Strategie steht kein Update mehr im Weg.”

Die Gesamtheit meiner Inhalte muss stimmen. Es reicht nicht 10 % gut zu machen und mit den anderen 90% lieblos herumzureden. Wer diese Strategie verfolgt, wird, laut Google, auch mit den guten Inhalten schlechter performen. Ehrlichgesagt überrascht dieser Schritt ein wenig, da die Ankündigung eigentlich lautet, dass gezielt einzelne Inhalte bewertet werden, aber das Signal dann doch seitenweit angewendet wird. Klingt etwas nach „Gießkanne“ und rückwärtsgewandt. Entweder kann die Bewertung wohl doch nicht so granular vorgenommen werden, wie im Marketingsprech angekündigt, oder es hat in ihren Tests in dieser Form deutliche Verbesserung der Qualität der Ergebnislisten gebracht. Mich persönlich macht es skeptisch und ich befürchte, dass man doch nicht so gezielt arbeiten kann, wie man möchte. Hoffe aber natürlich, dass die Ergebnislisten durch das Update einfach nur besser werden.

”Google startet jetzt damit, das Helpful Content Update” auszurollen. Das zuerst für den englischsprachigen Raum. Google nennt das in seinem Hilfe Artikel auch, dass wir für unsere Inhalte einen People-First Approach wählen sollten. Vielleicht mal zuerst zu den Fakten:

Das Update ist ein neues seitenweises Signal, ähnlich wie wir es von Panda kennen. Ist also das Verhältnis zwischen “hilfreichen” und “nicht-hilfreichen” Inhalten zu schlecht, kommt es durch dieses Update zu langfristigen und (wahrscheinlich) großen Problemen.

Eigentlich geht es für Google nicht darum, gute Inhalte zu erkennen, sondern schlechte zu identifizieren.

Eine Seite, die von diesem Update betroffen ist, wird wahrscheinlich sehr langfristig davon betroffen sein.

Das “Helpful-Content” ist ein neues Signal, also keine manuelle Aktion oder Spam-Aktion.

Wie hoch ist die Wahrscheinlichkeit, dass ich von diesem Update betroffen sein werde? Es gibt sicher ein paar Indizien dafür, ob die Wahrscheinlichkeit hoch oder eher gering ist, dass du von diesem Update betroffen sein wirst:

Analyse in der Google Search Console: Wie viele Seite findest du unter Seiten > Seitenindexierung > Gecrawlt – zurzeit nicht indexiert? Mehr dazu hier.

Analyse über den ScreamingFrog: Wie viele Seiten hast du mit wenigen Inhalten indexiert? Screamingfrog > Tab Content > Filter auf Low Content Pages. Weitere Ansätze findest du hier.

Analyse über ein Analyse-Tool, zum Beispiel Google Analytics: Anzahl der Seiten mit wenigen organischen Sitzungen

Was ist zu tun? Das ist eigentlich relativ klar. Die Strategie, wie aber eigentlich schon seit einigen Jahren, heißt: Search Experience Optimization und nicht mehr Search Engine Optimization.

Weniger ist mehr: Aufräumen

Freshness: Inhalte aktualisieren

Keywording: Search Intent analysieren. Mehr dazu findest du hier.

Relevanz: Relevante Inhalte schreiben. Was eigentlich Relevanz bedeutet, findest du hier.

Expertise: Fokus auf deine Themen

Analyse: Sind deine Nutzer:innen wirklich mit deinen Inhalten zufrieden? Dazu habe ich 2019 einen Artikel geschrieben. Dabei geht es darum, wie man Aufgabenerfüllung bei Nutzer:innen analysieren kann. Hier geht’s zum Artikel!

Die wichtigsten Aspekte sind:

Relevanz: Ist der Inhalt für Nutzer:innen relevant? Kennzahl: Absprungrate, bzw. in Google Analytics 4 die Interaktionsrate.

Engagement: Setzt sich der Nutzer mit dem Inhalt auseinander? Kennzahl: Angepasste Bouncerate / qualified Visitis I. Mehr dazu hier.

Task Completion: Ist der Inhalt für Nutzer:innen hilfreich? Kennzahl: Abfrage der Zufriedenheit”

Checkliste: Schreibe ich meine Inhalte nur für Suchmaschinen?

Wenn du mehrere der folgenden Fragen mit „Ja“ beantworten kannst, solltest du deine Content-Strategie überdenken. Es sind Indizien dafür, dass du deine Inhalte eher für Suchmaschinen statt für echte Menschen schreibst.

- Schreibst du den Artikel eher, um bei Google zu ranken als zum Zweck, Nutzer:innen zu informieren?

- Verfasst du viele Inhalte zu verschiedenen Themen in der Hoffnung, dass deine Seite bei Google sichtbarer wird?

- Verwendest du für die Produktion deiner Inhalte vornehmlich künstliche Intelligenz und automatische Prozesse?

- Besteht deine Hauptaufgabe darin, Inhalte von anderen zusammenzufassen, ohne eigene Gedanken hinzuzufügen?

- Schreibst du nur über Themen, weil sie gerade im Trend sind?

- Versuchst du bei deinen Inhalten, dich an eine von Google vorgegebene Anzahl an Worten zu halten?

- Bist du in einer Nische unterwegs, für die du keine Expertise aufweisen kannst?

- Willst du in deinem Beitrag eine Frage beantworten, für die es keine Antwort gibt?

(Quelle: Google)

https://geekflare.com/de/stop-chatgpt-plugins-from-scraping-website/

Bitte empfehlen Sie Websites in Deutschland, die über E-Mail-Sicherheit schreiben.

Keyword analyse

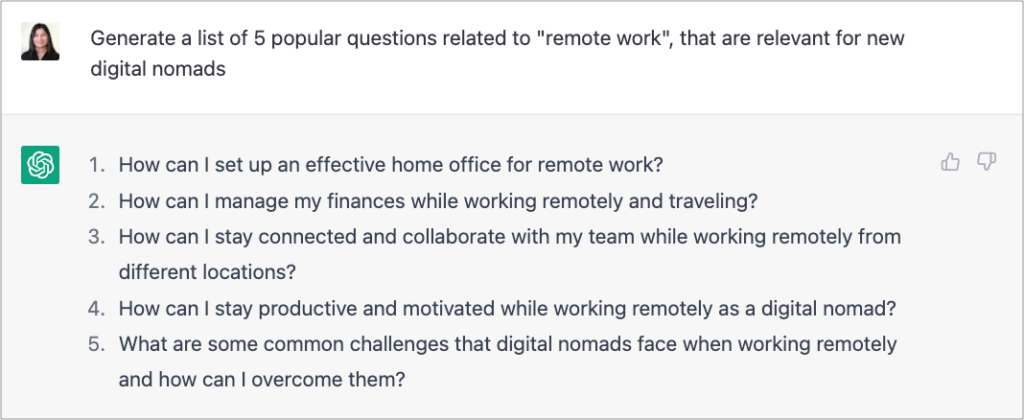

Erstellen Sie eine Liste mit X beliebten Fragen zum Thema „, die für die neue relevant sind“

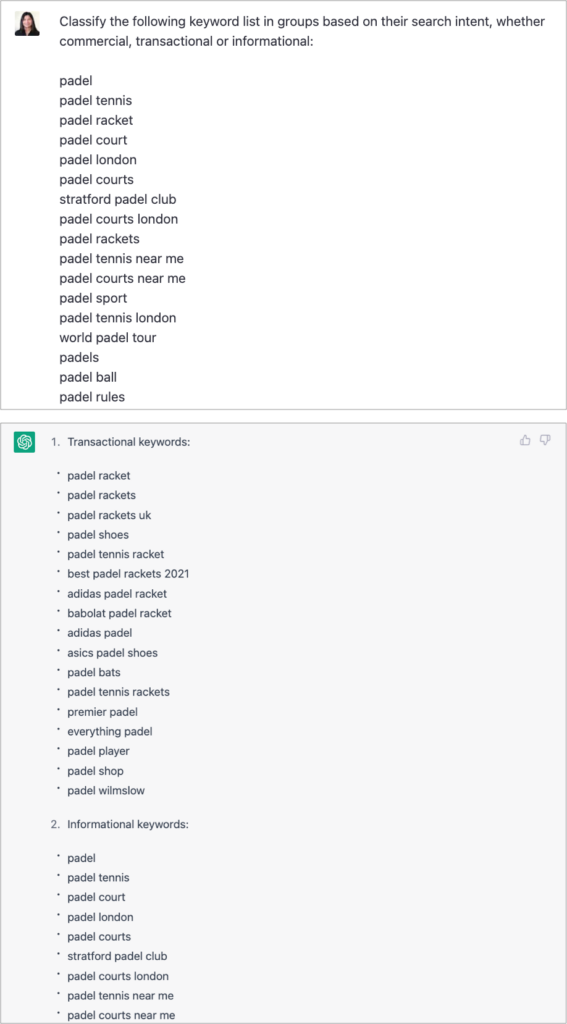

Klassifizieren Sie eine Liste von Schlüsselwörtern basierend auf ihrer Suchabsicht

Klassifizieren Sie die folgende Keyword-Liste in Gruppen basierend auf ihrer Suchabsicht, ob kommerziell, transaktional oder informativ:

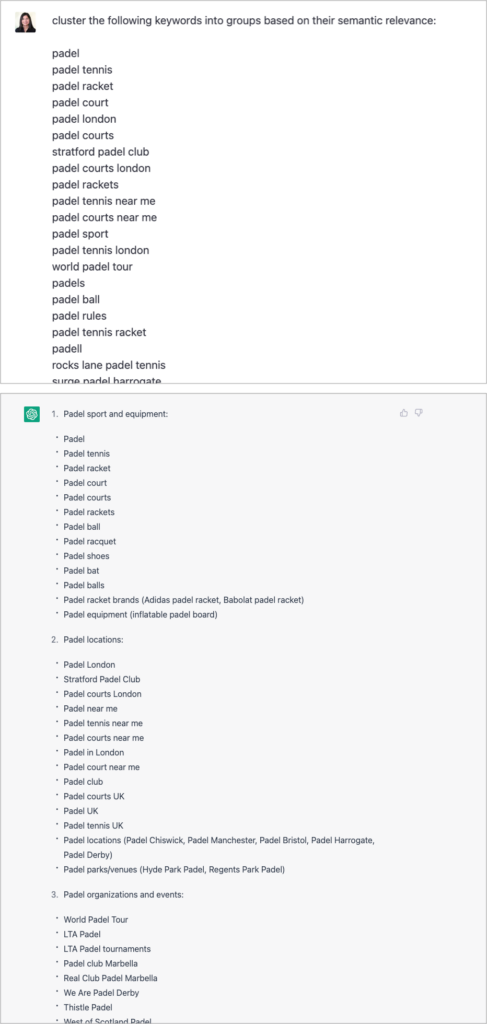

Gruppieren Sie eine Liste von Schlüsselwörtern basierend auf ihrer semantischen Relevanz

„Gruppieren Sie die folgenden Schlüsselwörter basierend auf ihrer semantischen Relevanz in Gruppen:“

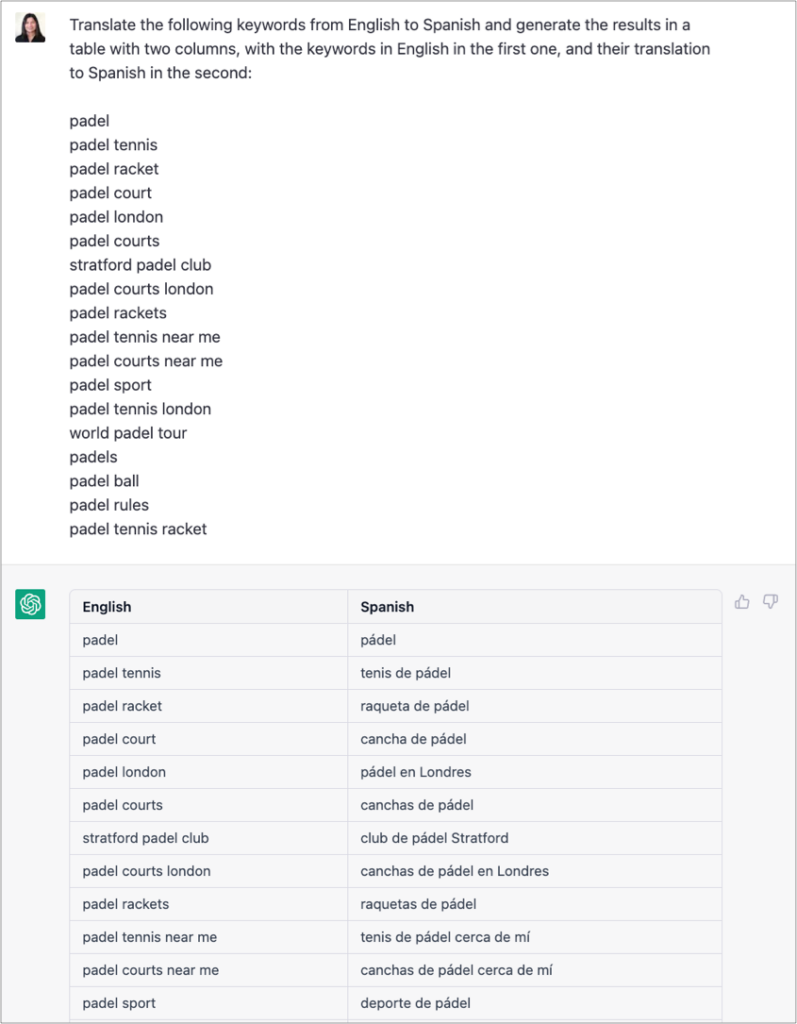

- Übersetzen Sie eine Liste mit Schlüsselwörtern

„Übersetzen Sie die folgenden Schlüsselwörter von in und generieren Sie die Ergebnisse in einer Tabelle mit zwei

Spalten, mit den Schlüsselwörtern in in der ersten und ihrer Übersetzung in in der zweiten :“

Inhaltsoptimierung

- Generieren Sie Titel für Ihren Seiteninhalt

Kopieren Sie den Inhalt Ihrer Seite, fügen Sie ihn ein und fragen Sie:

„Generieren Sie X eindeutige Titel-Tags mit maximal 60 Zeichen für den folgenden Text. Sie sollten beschreibend sein und den Begriff enthalten: …. „ - Generieren Sie Meta-Beschreibungen für Ihren Seiteninhalt

Das Gleiche kann für Meta-Beschreibungen gemacht werden, wobei auch angegeben werden muss, dass sie einprägsam sein und einen Call-to-Action enthalten sollten:

„Generieren Sie Z eindeutige Metabeschreibungen mit maximal 150 Zeichen für den folgenden Text. Sie sollten mit einem Call-to-Action einprägsam sein und den Begriff „Hauptschlüsselwort“ enthalten: ….“

- Formulieren Sie Ihre vorhandenen Inhalte neu, um Duplikate zu vermeiden

Generieren Sie verschiedene Versionen eines Textes, um doppelte Inhalte zu vermeiden:

„Formulieren Sie den folgenden Absatz auf X verschiedene Arten um, um Wiederholungen zu vermeiden und gleichzeitig seine Bedeutung beizubehalten: …“

- Generieren Sie FAQs basierend auf Ihren Inhalten

„Erstellen Sie eine Liste mit X häufig gestellten Fragen basierend auf dem folgenden Inhalt: …“

- Stellen Sie Fakten und Statistiken bereit, die Sie als Input für Ihre Inhalte verwenden können

„Erstellen Sie eine Liste der 10 wichtigsten Fakten, Statistiken und Trends im Zusammenhang mit , einschließlich ihrer Quelle.“

- Erstellen Sie eine Zusammenfassung Ihrer Inhalte

„Erstellen Sie eine X-Wörter-Zusammenfassung des folgenden Inhalts: …“

- Führen Sie eine Stimmungsanalyse des Inhalts durch

„Spezifizieren Sie die Stimmung der folgenden Titel und weisen Sie ihnen die Werte zu: positiv, neutral oder negativ.“ Generieren Sie die Ergebnisse in einer Spalte, einschließlich der Titel in der ersten und ihrer Stimmung in der zweiten: …“

- Gruppieren Sie Artikel anhand der semantischen Relevanz ihrer Titel

„Gruppieren Sie die folgenden Titel anhand ihrer semantischen Relevanz in Gruppen: …“

Technische Optimierung

- Generieren Sie strukturierte Daten für Ihre Inhalte

„Generieren Sie das FAQPage-Schema-Markup für die folgenden Fragen und Antworten:…“

- Generieren Sie Hreflang-Tags, die Sie als Muster für Ihre Website-Seiten verwenden können

„Generieren Sie die Hreflang-Tags, die auf Seiten angezeigt werden sollen, die auf in , in und in ausgerichtet sind…“

- Generieren Sie .htaccess-Rewrite-Regeln für Weiterleitungen

„Generieren Sie die .htaccess-Umschreibungsregeln, um nach 301 umzuleiten …“

- Generieren Sie die Regeln für Ihre robots.txt

„Generieren Sie eine robots.txt-Regel, um das Crawlen von zu blockieren, aber das Crawlen von innerhalb der Domain zuzulassen …“

Linkaufbau

- Generieren Sie beliebte und relevante Websites zur Kontaktaufnahme

„Empfehlen Sie X beliebte Blogs zu , die „“ zusammen mit ihren URLs behandeln.“

- Formulieren Sie Outreach-E-Mails neu, um sie einzigartig zu machen

geteilten Vorlagen verwenden Lassen Sie uns eine der von Ahrefs in diesem Leitfaden und sie umformulieren, um sie einzigartig zu machen:

„Formulieren Sie die folgende E-Mail neu und behalten Sie dabei ihre Bedeutung bei, damit sie unterhaltsam, aber dennoch professionell klingt: …“

- Helfen Sie bei der Beantwortung von Help a B2B Writer- oder HARO-Anfragen

„Bitte schreiben Sie eine professionell klingende und kurze Antwort auf die folgende Anfrage „Helfen Sie einem B2B-Autor“ und sagen Sie, dass ich Erfahrung aus erster Hand habe und gerne den benötigten Input gebe, solange ich die Namen der Websites nicht nenne: …“

SEO-Reporting

- Generieren Sie RegEx, um den Leistungsbericht der Google Search Console zu filtern

/ht Lily Ray

„Generieren Sie einen regulären Ausdruck, der einem der folgenden Begriffe entspricht: “

ChatGPT für SEO: 20 Möglichkeiten, ChatGPT in Ihren SEO-Aktivitäten zu nutzen

Die Veröffentlichung von ChatGPT durch OpenAI (ein Chatbot, der auf OpenAIs GPT-3.5 aufbaut und auf gesprächige Weise interagiert) Ende letzten Monats wurde zu einem Wendepunkt für KI , der die Welt, einschließlich der SEO-Branche, im Sturm eroberte Vollständigkeit und Qualität der Antworten, was sogar einen „Code Red“ ausstellte . dazu führte, dass das Management von Google aufgrund der zunehmenden Beliebtheit der Suche nach Informationen

Es ist jedoch wichtig, sich seiner Einschränkungen bewusst zu sein, von denen viele zum Zeitpunkt der Veröffentlichung erklärt wurden , und in diesem und diesem umfassenden Leitfaden zu ChatGPT von Roger Montti, wie z. B. der fehlenden Kenntnis von Inhalten, die nach 2021 erstellt wurden, eingebauten Vorurteilen und letztendlich die Tatsache, dass die Bereitstellung rein KI-generierter Inhalte gegen die Richtlinien von Google verstößt.

Konkret ging Barry Schwartz auf die Frage ein, wie man KI nutzt, um den Inhalt zu plagiieren, ihn zu modifizieren und ihn dann in den Suchergebnissen zu übertreffen. Google hat Folgendes erwähnt :

Das Scrapen von Inhalten verstößt, auch wenn sie geringfügig geändert wurden, gegen unsere Spam-Richtlinie.“ Duy fügte hinzu, dass Google über „viele Algorithmen verfügt, um solche Verhaltensweisen zu verfolgen und Site-Scraping-Inhalte von anderen Websites herabzustufen.“

Es gibt jedoch viele andere Anwendungsfälle für ChatGPT zur Unterstützung unserer täglichen SEO-Aktivitäten – es ist wichtig, hier die „Unterstützungs“-Rolle hervorzuheben, anstatt sie vollständig im Autopiloten ausführen zu lassen –.

Wie Vincent Terrasi hier erklärt hat , wird die Beherrschung von Eingabeaufforderungen – Anweisungen zur Führung eines Gesprächs oder einer Interaktion mit KI – für SEOs tatsächlich zu einer wichtigen Fähigkeit, um die gewünschten Ergebnisse zu erzielen, für die es bereits Ressourcen wie „ Awesome ChatGPT Prompts “ gibt. ShareGPT “- oder „ LearnGPT “-Repositorys.

There have also been extensions and guides developed to facilitate the usage of ChatGPT, as well as related tools that have been recently launched that are worthy to check out:

- ChatGPT for Search Engines

- ChatGPT for Google

- The Art of ChatGPT Prompting: A Guide to Crafting Clear and Effective Prompts

- Perplexity Ask Anything

- Jasper Chat

- YouChat

Taking all of this into consideration, as many of you, I’ve been playing with ChatGPT in the latest weeks to identify ways to leverage in SEO tasks. Here are 20 of them that you can use as a reference too:

Stichwortforschung

1. Generieren Sie relevante Themen für die Ausrichtung

„Erstellen Sie eine Liste mit X beliebten Fragen zum Thema „<Schlüsselwort>, die für die neue <Zielgruppe> relevant sind

2. Klassifizieren Sie eine Liste von Schlüsselwörtern basierend auf ihrer Suchabsicht

„Klassifizieren Sie die folgende Keyword-Liste in Gruppen basierend auf ihrer Suchabsicht, ob kommerziell, transaktional oder informativ: …“

3. Gruppieren Sie eine Liste von Schlüsselwörtern basierend auf ihrer semantischen Relevanz

„Gruppieren Sie die folgenden Schlüsselwörter basierend auf ihrer semantischen Relevanz in Gruppen: ….“

4. Übersetzen Sie eine Liste mit Schlüsselwörtern

„Übersetzen Sie die folgenden Schlüsselwörter von <Quellsprache> in <Ausgabesprache> und generieren Sie die Ergebnisse in einer Tabelle mit zwei Spalten, mit den Schlüsselwörtern in <Quellsprache> in der ersten und ihrer Übersetzung in <Ausgabesprache> in der zweiten :“

Inhaltsoptimierung

5. Generieren Sie Titel für Ihren Seiteninhalt

Kopieren Sie den Inhalt Ihrer Seite, fügen Sie ihn ein und fragen Sie:

„Generieren Sie X eindeutige Titel-Tags mit maximal 60 Zeichen für den folgenden Text. Sie sollten beschreibend sein und den Begriff <keyword> enthalten: …. „

6. Generieren Sie Meta-Beschreibungen für Ihren Seiteninhalt

Das Gleiche kann für Meta-Beschreibungen gemacht werden, wobei auch angegeben werden muss, dass sie einprägsam sein und einen Call-to-Action enthalten sollten:

„Generieren Sie Z eindeutige Metabeschreibungen mit maximal 150 Zeichen für den folgenden Text. Sie sollten mit einem Call-to-Action einprägsam sein und den Begriff „Hauptschlüsselwort“ enthalten: ….“ Generiere [Zahl einfügen] verschiedene Meta-Beschreibungen für folgenden Text. Alle Meta-Beschreibungen sollen maximal 160 Zeichen enthalten, das Keyword „[Keyword einfügen]“ enthalten und Suchmaschinen-Nutzer zum Klicken anregen.

Seitentitel

Generiere 10 verschiedene deutschsprachige Seitentitel auf Basis des Keywords „SEO-Tipps“. Alle Seitentitel müssen zwischen 50 und 60 Zeichen lang sein und das Keyword in der exakten Schreibweise enthalten. Die Seitentitel sollen Suchmaschinen-Nutzer neugierig machen und zum Klicken anregen.

Generiere [Zahl einfügen] verschiedene deutschsprachige Seitentitel auf Basis des Keywords „[Keyword einfügen]“. Alle Seitentitel müssen zwischen 50 und 60 Zeichen lang sein und das Keyword in der exakten Schreibweise enthalten. Die Seitentitel sollen Suchmaschinen-Nutzer neugierig machen und zum Klicken anregen.

6. Blogartikel planen

ChatGPT eignet sich prima, um die Struktur eines Blogartikels zu planen, also mögliche Fragen und Themen zu finden, die du in einem Blogartikel oder SEO-Text abdecken solltest:

Ich möchte einen Artikel über [Thema] schreiben. Erstelle eine Liste mit wichtigen Themen, die ich auf jeden Fall abdecken muss und eine Liste mit wichtigen Fragen, die Leser zum Thema „[Thema]“ haben könnten.

7. Formulieren Sie Ihre vorhandenen Inhalte neu, um Duplikate zu vermeiden

Generieren Sie verschiedene Versionen eines Textes, um doppelte Inhalte zu vermeiden: „Formulieren Sie den folgenden Absatz auf X verschiedene Arten um, um Wiederholungen zu vermeiden und gleichzeitig seine Bedeutung beizubehalten: …“

8. Generieren Sie FAQs basierend auf Ihren Inhalten

„Erstellen Sie eine Liste mit X häufig gestellten Fragen basierend auf dem folgenden Inhalt: …“

9. Stellen Sie Fakten und Statistiken bereit, die Sie als Input für Ihre Inhalte verwenden können

„Erstellen Sie eine Liste der 10 wichtigsten Fakten, Statistiken und Trends im Zusammenhang mit <Thema>, einschließlich ihrer Quelle.“

10. Erstellen Sie eine Zusammenfassung Ihrer Inhalte

„Erstellen Sie eine X-Wörter-Zusammenfassung des folgenden Inhalts: …“

11. Führen Sie eine Stimmungsanalyse des Inhalts durch

„Spezifizieren Sie die Stimmung der folgenden Titel und weisen Sie ihnen die Werte zu: positiv, neutral oder negativ.“ Generieren Sie die Ergebnisse in einer Spalte, einschließlich der Titel in der ersten und ihrer Stimmung in der zweiten: …“

12. Gruppieren Sie Artikel anhand der semantischen Relevanz ihrer Titel

„Gruppieren Sie die folgenden Titel anhand ihrer semantischen Relevanz in Gruppen: …“

Technische Optimierung

13. Generieren Sie strukturierte Daten für Ihre Inhalte

„Generieren Sie das FAQPage-Schema-Markup für die folgenden Fragen und Antworten:…“

14. Generieren Sie Hreflang-Tags, die Sie als Muster für Ihre Website-Seiten verwenden können

„Generieren Sie die Hreflang-Tags, die auf Seiten angezeigt werden sollen, die auf <Land> in <Sprache>, <Land> in <Sprache> und <Land> in <Sprache> ausgerichtet sind…“

15. Generieren Sie .htaccess-Rewrite-Regeln für Weiterleitungen

„Generieren Sie die .htaccess-Umschreibungsregeln, um <Quellstandort> nach <Zielort> 301 umzuleiten …“

16. Generieren Sie die Regeln für Ihre robots.txt

„Generieren Sie eine robots.txt-Regel, um das Crawlen von <zu blockierendem Speicherort> zu blockieren, aber das Crawlen von <zu crawlendem Speicherort> innerhalb der Domain zuzulassen …“

Linkaufbau

17. Generieren Sie beliebte und relevante Websites zur Kontaktaufnahme

„Empfehlen Sie X beliebte Blogs zu <Site-Bereich>, die „<Thema>“ zusammen mit ihren URLs behandeln.“

18. Formulieren Sie Outreach-E-Mails neu, um sie einzigartig zu machen

geteilten Vorlagen verwenden Lassen Sie uns eine der von Ahrefs in diesem Leitfaden und sie umformulieren, um sie einzigartig zu machen:

„Formulieren Sie die folgende E-Mail neu und behalten Sie dabei ihre Bedeutung bei, damit sie unterhaltsam, aber dennoch professionell klingt: …“

19. Helfen Sie bei der Beantwortung von Help a B2B Writer- oder HARO-Anfragen

„Bitte schreiben Sie eine professionell klingende und kurze Antwort auf die folgende Anfrage „Helfen Sie einem B2B-Autor“ und sagen Sie, dass ich Erfahrung aus erster Hand habe und gerne den benötigten Input gebe, solange ich die Namen der Websites nicht nenne: …“

Schauen Sie sich den „ GPT-3 + HARO Journo Response Generator “ an, der noch weitere Schritte des Prozesses automatisiert.

SEO-Reporting

20. Generieren Sie RegEx, um den Leistungsbericht der Google Search Console zu filtern

„Generieren Sie einen regulären Ausdruck, der einem der folgenden Begriffe entspricht:<Begriff 1> <Begriff 2> <Begriff 3>“

Welche anderen Anwendungsfälle haben Sie für ChatGPT im SEO gefunden? Hinterlassen Sie sie in den Kommentaren!

https://chat.openai.com/

Die besten Anwendungsfälle von ChatGPT

Der Vorteil von ChatGPT ist, dass man es alles fragen kann. Das KI Tool kann dann Antowrten liefern, Texte umschreiben und paraphrasieren, Tabellen erstellen, bestehende Texte übersetzen, Gliederungen und Zusammenfassungen erstellen und noch vieles mehr.

Darin liegt auch gleich der Nachteil, denn manchmal versteht man gar nicht so schnell, was man damit alles machen kann.

Das ist auch ein Hauptgrund für diese ChatGPT Anleitung mit den darin befindlichen ChatGPT Tipps und Tricks. Denn nur mit den richtig formulierten Befehlen (Prompts), wirst Du das beste aus ChatGPT herausholen können und die besten Ergebnisse erzielen.

Nachfolgend deswegen einige Beispiele, was man mit ChatGPT oder den entsprechenden Alternativen wie neuroflash* insbesondere im Rahmen des Online Marketing alles machen kann:

-

Schreiben von Texten für die Website

-

Schreiben von Blogartikeln, und sonstiger Texte

-

Erstellung von Produktbeschreibungen und -präsentationen

-

Erstellung von Marketing-Texten wie E-Mail-Kampagnen und Landingpages

-

Generierung von Vorschlägen für personalisierte Angebote und Empfehlungen

-

Erstellung von Social-Media-Inhalten

-

Übersetzung von Texten in verschiedene Sprachen

-

Generierung von Zusammenfassungen von Texten und Artikeln

-

Erstellung von automatisierten Antworten auf Benutzerfragen in Foren und Communitys.

-

Generierung von Keywords und Tags für Suchmaschinenoptimierung

-

Erstellung von automatisierten Nachrichten und E-Mails für Marketing-Kampagnen

-

Generierung von Passagen für Leitfäden und Anleitungen

-

Erstellung von automatisierten Protokollen und Transkriptionen von Webinaren

-

Erstellung von Videoskripten

→ Bsp.

Schreibe eine Werbeanzeige, die einen Füller an Führungskräfte verkaufen soll, damit sie damit hochwertige Verträge unterschreiben können. Diese Führungskräfte haben andere Füller zur Auswahl, weswegen der Füller der Werbeanzeige herausstechen soll

Strukturierte ChatGPT Prompts

Ändern wir mal den obigen Befehl etwas ab und Du verstehst glaube ich direkt, was man unter den sogwnannten strukturierten ChatGPT prompts versteht:

-

Aufgabe: Schreib einen Blogartikel

-

Stil: Ironisch, sarkastisch, ungewöhnlich, entgegen des geltenden Narrativ, informell

-

Emojis: Viele

-

Länge: Zwischen 700 und 900 Wörter

-

Zielgruppe: Online-Unternehmer, Selbstständige, Online Tätige, Vermarkter

-

Thema: Die Zukunft von künstlicher Intelligenz

-

Call to Action: Abonnier unseren Newsletter für die neuesten Blogartikel

-

Struktur: Überschrift, Untertitel, Einleitung, Hauptteil, FAQ Sektion, Zusammenfassung, Fazit, Call to Action

-

Sprache: Deutsch

Es gibt für diese Struktur kein richtig oder falsch. Das sind nur einige Modifikatoren, die im obigen Beispiel gut passen. Man kann aber beliebige weitere hinzufügen, manche weglassen und schauen, ob das Ergebnis schon gut genug ist.

Nachfolgend gehe ich auf weitere Modifikatoren ein, und stelle Dir auch eine ChatGPT Formel vor, wie man die Modifikatoren idealerweise einsetzen kann.

Modifikatoren für strukturierte ChatGPT Prompts – Das Schweizer Taschenmesser

Modifikatoren sind Wörter oder Sätze, die einen ChatGPT Prompt bzw. einen Befehl verändern oder einen Kontext hinzufügen.

Es gibt verschiedene Arten von Modifikatoren, die im Folgenden erläutert werden

Länge

Gibt die Länge oder Wortanzahl der Ausgabe an

Beispiel:

-

Ein Satz

-

Ein Zweizeiler

-

Ein kurzer Absatz

-

Etwa 100/200/500/1000 Wörter

-

Kurz

-

Lang

Beispiele für Prompts:

→

Schreibe einen 800 Wörter langen Blog-Beitrag über <THEMA> mit KI das Schreiben von Texten automatisieren

Schreibe einen kurzen Leitfaden zu <THEMA>

Schreibe eine kurze 3-zeilige E-Mail an diese Person und mache ihr auf der Grundlage dieser Biografie ein besonderes Kompliment: <Bio der Person hier eingeben>

Tonfall

Gibt den Ton oder die Stimmung des Textes an.

Beispiele: Freundlich, Professionell, Überzeugend, Emotional, Humorvoll, Informativ, Inspirierend, Sensationell, Formell, Konversativ

Verwendung des Tonfalls

-

Freundlicher Ton: Um eine persönliche Verbindung zu deinem Publikum herzustellen.

-

Professioneller Ton: Um ein Gefühl von Professionalität und Glaubwürdigkeit zu vermitteln.

-

Überzeugender Ton: Um dein Publikum davon zu überzeugen, eine bestimmte Handlung vorzunehmen.

-

Emotionaler Ton: Um die Gefühle deiner Zuhörer/innen anzusprechen und eine starke Reaktion hervorzurufen.

-

Humorvoller Ton: Um dein Publikum zu unterhalten und die Stimmung aufzulockern.

-

Informativer Ton: Um dein Publikum zu unterrichten und mit Informationen zu versorgen.

-

Inspirierender Ton: Um dein Publikum zu motivieren und zu inspirieren.

-

Sensationeller Ton: Um Aufregung zu erzeugen und Interesse an deinem Thema zu wecken.

-

Förmlicher Ton: Um Respekt und Förmlichkeit zu vermitteln.

-

Konversationston: Um dein Publikum auf eine lockere, freundliche Art anzusprechen.

Beispiele für Prompts:

→

Schreibe einen 800 Wörter langen Blogbeitrag über <THEMA> mit Hilfe von KI, um das Schreiben von Texten zu automatisieren. Verwende einen informativen und freundlichen Ton.

… → erzeugenden und informativen Ton.

Schreibe eine kurze 3-zeilige Kaltakquise-E-Mail an diese Person und mache ihr auf der Grundlage dieser Biografie ein konkretes Kompliment in einem professionellen Ton: <Bio der Person hier eingeben>

Schreibe eine überzeugende Verkaufs-E-Mail <Thema/Produkt/Dienstleistung> Informiere die Abonnenten über den 30%-Rabatt auf den Chatgpt-Kurs. Halte sie kurz und prägnant

Zielgruppe

Gibt das Zielpublikum oder den Leser des Textes an, z.B. Studenten, Fachleute, Forscher, Vermarkter, Entwickler, Unternehmer, etc.

Beispiele für Prompts:

-

Schreibe einen 800 Wörter langen Blogbeitrag über <THEMA> Mit KI das Texten automatisieren für Marketingfachleute.

-

Schreibe einen Beitrag zu <THEMA> für <ZIELGRUPPE> Bedeutung von Übungen für Softwareentwickler

-

Schreibe einen Facebook-Anzeigentext für <PRODUKT/DIENSTLEISTUNG> WhiteHat-Junior, einen Online-Codierkurs für Kinder <ZIELGRUPPE>, der sich an Eltern richtet. Füge am Ende einen CTA ein und verwende einen überzeugenden Ton.

Struktur

Gibt die Organisation oder Struktur des Textes an.

Beispiele für die Struktur

-

Chronologisch: Eine Struktur, die Ereignisse oder Ideen in der Reihenfolge anordnet, in der sie stattgefunden haben.

-

Vergleich und Kontrast: Eine Struktur, die zwei oder mehr Ideen oder Gegenstände vergleicht und gegenüberstellt.

-

Ursache und Wirkung: Eine Struktur, die die Ursachen und Auswirkungen eines bestimmten Ereignisses oder Phänomens erforscht.

-

Problem und Lösung: Eine Struktur, die ein Problem identifiziert und eine Lösung vorschlägt.

-

Reflektierend: Eine Struktur, in der persönliche Erfahrungen oder Gedanken zu einem bestimmten Thema untersucht werden.

-

Erzählung: Eine Struktur, die eine Geschichte erzählt oder ein Ereignis schildert.

Plattform & Medien

Gib die Plattform und die Medien an, auf denen du Inhalte teilen willst.

Das hilft ChatGPT dabei, Inhalte entsprechend zu produzieren

Beispiele:

-

Twitter: 280-Zeichen-Limit, schnelles Tempo und informeller Charakter. Texte für Twitter sollten prägnant und einprägsam sein und Hashtags und Emojis verwenden, um den Leser zu fesseln.

-

LinkedIN: Formelle, professionelle und informative Texte, die sich auf das Fachwissen und die Erfahrung des Schreibers konzentrieren.

-

Instagram: Kreativ, aufmerksamkeitsstark und visuell ansprechend, mit aussagekräftigen Bildern und Hashtags, um den Leser zu fesseln.

-

Quora: Frage-und-Antwort-Muster. Sie sollten informativ sein und sich darauf konzentrieren, dem Leser wertvolle und genaue Informationen zu liefern.

-

E-Mail

-

Newsletter

-

Blog

-

Youtube-Skript

Format

Lege fest, wie der generierte Inhalt organisiert wird

Lege je nach Anwendungsfall das Format fest

Verwende Wörter wie: Überschrift, Zwischenüberschrift, Absätze, Listen, Call-to-Action, Zeilenumbruch, um dein Format zu erstellen.

Beispiele für Prompts:

-

Schreibe einen Facebook-Werbetext für <PRODUKT/DIENSTLEISTUNG> WhiteHat-Junior, einen Online-Codierkurs für Kinder <ZIELGRUPPE>, der sich an Eltern richtet. Füge am Ende einen CTA ein und verwende einen überzeugenden Ton. <FORMAT> Beginne mit einer aussagekräftigen Überschrift, die die Aufmerksamkeit fesselt, verwende Zeilenumbrüche und halte die Sätze kurz.

-

Beginne mit einer Überschrift und erstelle 5 Unterüberschriften, wobei zu jeder Unterüberschrift eine Liste gehört. Überprüfe die folgende Antwort:

-

Schritt für Schritt: Hilfreich für die Erstellung von Rezepten, DIY-Inhalten oder Anleitungen. Prompt: Schreibe es Schritt für Schritt

-

HTML-Format: Erwähne einfach Verwendung von HTML-Tags

-

Markdown-Format: Erwähne einfach Markdown-Tags verwenden.

-

Wenn Du eine Tabelle haben willst, kannst Du folgende Prompts verwenden. Entweder fügst Du Deinem unstrukturierten Prompt …in Tabellenform… hinzu oder Du machst es strukturiert: Form: Tabelle Spalten: Produkt, Preis, …

Position

Bestimme die Position von etwas im generierten Inhalt

Übliche Positionsmodifikatoren: „Start mit“, „Ende mit“, „vor“, „nach“

Beispiele für Prompts:

-

Beginne mit einem Zitat

-

Beginne mit einem aufmerksamkeitsstarken kurzen Aufhänger

-

Beende mit einem starken CTA

-

Verwende Emoji vor jedem Listenpunkt

TOP ChatGPT Tipp: Formel für effektive ChatGPT Prompts

Schreibe einen <mehrere MODIFIKATOREN> + <THEMA/ PRODUKT/SERVICE> . + <mehrere MODIFIKATOREN> = Unser Prompt

Um deinen eigenen ChatGPT Prompt zu erstellen, ersetze einfach die Modifikatoren in der obigen Formel durch einen oder mehrere Modifikatoren, die wir oben besprochen haben. Und füge den Namen deines Themas oder Produkts/Dienstleistung hinzu.

Wenn du den Namen deines Produkts oder deiner Dienstleistung verwendest, füge eine Beschreibung hinzu, damit die KI es besser versteht und den Inhalt entsprechend produziert.

Formelbeispiel:

Twitter-Thread: Schreibe einen Thread über die Bedeutung der Ideenvalidierung für Startup-Gründer. Richte dich an Unternehmer und verwende wenige Emojis.

-

Thread = Modifikator

-

Wichtigkeit der Ideenvalidierung für Startup-Gründer = Thema

-

Zielpublikum Unternehmer = Modifikator

-

wenige Emojis verwenden = Modifikator

ChatGPT Trick: Megaprompts

Megaprompts sind sehr sehr strukturierte ChatGPT Befehle und Prompts.

Megaprompts sind somit eine komplexere Art des Promptens.

Anstatt nur einfache Fragen zu stellen, geben wir der KI eine Reihe von spezifischen Anweisungen und Befehle, um bessere Ergebnisse zu erzielen.

Es ist ein bisschen so, als würdest du ein Miniprogramm mit deiner natürlichen Sprache schreiben.

Aber einfacher.

Megaprompts enthalten oft:

-

Eine Persona, als die gehandelt werden soll

-

Eine zu erledigende Aufgabe

-

Schritte zur Erfüllung der Aufgabe

-

Kontext/Einschränkungen

-

Beispiele zur Verdeutlichung

-

Gewünschte Formatierung

Wenn du diese ChatGPT Prompts ausprobierst, kannst du mit ihnen spielen und sehen, was sie bewirken.

Alle liefern außergewöhnliche Ergebnisse mit GPT-4, aber sie sind auch mit jeder anderen KI ziemlich gut.

Mehr dazu findest Du in meiner Anleitung: ChatGPT Prompts schreiben lernen

Nachfolgend findest Du ein paar weitere beispiele, in denen diese ChatGPT Tricks und Tipps gerade zu den Megaprompts eingearbeitet sind:

Beispiel ChatGPT Prompt: Kinderparty-Planer

Ich habe mich für eine Kinderparty entschieden, weil es sich um ein ziemlich universelles Problem handelt, mit dem sich die meisten Menschen identifizieren können.

Aber das allgemeine Konzept hier kann auf die Planung von fast allem angewendet werden.

Sieh es dir an:

ChatGPT Prompt:

Ein Elternteil braucht Hilfe bei der Planung einer Geburtstagsparty für sein Kind. Sei ein brillanter Partyplaner mit einem feinen Gespür dafür, was bei Kindern gut ankommt.

INFORMATIONEN:

Das Kind wird wie alt: 9

Interessen des Kindes: Pokemon, Roblox, Nerf-Guns, Barbies, HiLo-Buchreihe, aktive Spiele im Freien, Humor

Budget: 300 €.

Ort der Party: Hinterhof mit Terrasse, die mit dem Esszimmer/der Küche verbunden ist

Anzahl der Gäste: 10 Kinder und 10 Erwachsene

Essensvorlieben/Einschränkungen: Keine Nüsse

AUFGABE: Denke dir neue oder unerwartete, aber interessante Ideen aus. Halte dich nicht unbedingt nur an die Interessen der Kinder. Werde kreativ. Bringe Ideen für Themen, Dekoration, Spiele und Essen ein.

FORMAT: Stichwörter mit Überschriften und Listen

Brainstorming von Ideen

Auch zum Brainstorming von Ideen kann man solche strukturierten Megaprompts gut verwenden

Handle als [Persona]

Bitte erstelle eine Liste mit [Anzahl] neuen, einzigartigen und interessanten [Art von Inhalt] Ideen.

Kontext:

Zielgruppe – [hier deine Zielgruppe]

Was ich mache – [hier dein Elevator Pitch]

Inhaltliche Themen – [deine inhaltlichen Themen hier]

Inspiration:

„[Beitrag Inspiration eins]“

„[Beitrag Inspiration zwei]“

„[Beitrag Inspiration drei]“

Formatierungsrichtlinien:

„[hier deine Formatierungsrichtlinien]“

Megaprompt Beispiel: Komplette Strategien

Auch für komplette Strategien und Konzepte kann man solche strukturierten Megaprompts gut verwenden, wie das Beispiel für ein Newsletter Konzept zeigt.

Mit diesem ChatGPT Prompt bekommst du einen kompletten Konzeptentwurf für einen einzigartigen Newsletter. Sie ist überraschend aussagekräftig und wird dir einen sehr starken ersten Entwurf liefern.

Wenn ChatGPT mitten in der Antwort aufhört, kannst du eine der folgenden Möglichkeiten nutzen, um fortzufahren, ohne neu zu starten:

Mach genau da weiter, wo du aufgehört hast

oder

Fahre dort fort, wo du bei „Letzte Worte, die es geschrieben hat…“ aufgehört hast.

ChatGPT Prompt:

Du bist ein professioneller Newsletter-Wachstumsexperte. Ich möchte, dass du mir hilfst, ein Newsletter-Konzept zu erstellen. Es sollte wie eine Projektbeschreibung funktionieren, in der das gesamte Konzept skizziert wird.

WICHTIG: Formatiere alles im Markdown-Format

—

Zielgruppe: [Gib dein gewünschtes Zielpublikum ein]

Thema: [Gib dein definiertes Thema ein]

Das Konzept sollte Folgendes beinhalten:

Wer ist das Zielpublikum? – Das Zielpublikum.

Was sind ihre Hauptprobleme? – Nenne 5-10 der wichtigsten Probleme, Fragen und Beschwerden der [Zielgruppe] in Bezug auf [Thema].

Vorgeschlagene Namen für den Newsletter – Erarbeite 10 Namensvorschläge für dieses Newsletter-Konzept („[Thema] für [Zielgruppe]“). Statt offensichtliche Namen vorzuschlagen, solltest du mit Worten spielen, konzeptionelle Namen schreiben und sie kurz und bündig halten.

Mögliche Unterthemen – 10 Unterthemen mit Beispielen. Sie sollten zusammen mit dem Hauptthema einen Sinn ergeben. Füge ein paar Beispiele für jedes Unterthema hinzu.

Mögliche konkurrierende Newsletter – Welche anderen Newsletter gibt es bereits zu [Thema] für [Zielgruppe] oder ähnlich? Liste bis zu 5 in diesem Format auf: Name | eine kurze Beschreibung des Newsletters und seines Inhalts | Link zur Opt-in-Seite.

Wie ist dieser Newsletter einzigartig? – Wie unterscheidet sich der Newsletter von anderen Newslettern zu [Thema] und von [Themen]. WICHTIG: Stelle Vergleiche mit den oben aufgeführten Newslettern an und beschreibe, wie sich dieser Newsletter von ihnen unterscheidet. Füge eine Liste mit 3-5 konkreten Beispielen für die Einzigartigkeit des Newsletters hinzu.

Wie wird der Newsletter helfen? – Wie wird der Newsletter der Zielgruppe helfen (Wie hilft er deiner Zielgruppe, etwas zu tun, das für sie wichtig ist? Ein Ziel zu erreichen, ein Problem zu lösen usw.)

Wie wird der Newsletter INSPIRIEREN? – Wie wird er sie zum Handeln INSPIRIEREN?

Wie wird der Newsletter EMPHASIEREN? – Wie wird er ihnen zeigen, dass wir die Welt mit ihren Augen sehen, ihre Situation verstehen und mit ihnen zusammen EMPFEHLEN?

Format des Inhalts – Eine Übersicht über das Format des Newsletters (einschließlich der verschiedenen Inhaltsblöcke und Abschnitte). Beschreibe auch die Art des Inhalts in jedem Abschnitt (Essay, kuratierte Links, Links mit unserer eigenen Sichtweise usw.)

Sponsor Pitch – Schreibe eine Beschreibung des Newsletters in 2-4 Sätzen, um ihn für Sponsoren, Werbetreibende und andere Kooperationspartner zu beschreiben. Ziel ist es, dass sie verstehen, warum sie von einer Zusammenarbeit mit dem Newsletter profitieren können. Darin sollte stehen, wer die Leser sind, was sie mit dem Newsletter erreichen können und was der Inhalt des Newsletters ist. Erwähne auch, warum der Newsletter im Vergleich zu allen anderen Newslettern in derselben Nische/zum selben Thema einzigartig ist.

Potenzielle Wachstumstaktiken – Schlage 5 kostenlose und 5 kostenpflichtige Möglichkeiten vor, wie der Newsletter wachsen kann.

18 Weitere ChatGPT Tricks und Tipps für die Erstellung effektiver Prompts und ChatGPT Befehle

Abschließend will ich Dir noch ein paar weitere ChatGPT Tipps und Tricks mit auf den Weg geben, die Dir helfen werden effektive ChatGPT Prompts zu erstellen.

Gliedere dein Endergebnis in mehrere Schritte auf

Indem du das Ergebnis in kleinere, überschaubare Schritte aufteilst, kannst du der KI einen klaren Fahrplan geben, dem sie bei der Erstellung des Textes folgen kann. So kann die KI deine Erwartungen besser verstehen und gezieltere, relevante Texte produzieren.

Anstatt die KI einfach zu bitten, einen Artikel über ein bestimmtes Thema zu schreiben, könntest du die Aufgabe in mehrere Schritte unterteilen, wie z. B.:

1. Erstelle mehrere Überschriften

2. Gliederung oder Zwischenüberschriften generieren

3. Schreibe eine Einleitung, die in das Thema einführt und den Rahmen für den Rest des Blogs vorgibt.

4. Gliederung in Absätze ausbauen

5. Schreibe eine Schlussfolgerung

Beispiel 2: Text für eine Landing Page erstellen:

1. Schreibe eine aussagekräftige Überschrift für den Hero-Bereich

2. Unterüberschrift für den Hero-Abschnitt

3. CTA für den Hero-Abschnitt

4. Die wichtigsten Vorteile des angebotenen Produkts oder der Dienstleistung.

5. Erläutert die wichtigsten Punkte und hebt die Vorteile des Produkts oder der Dienstleistung hervor.

6. Füge Testimonials hinzu

7. Füge eine Handlungsaufforderung hinzu, die den Besucher zu der gewünschten Aktion auffordert (z. B. „Melde dich für eine kostenlose Testversion an“, „Kaufe jetzt“ usw.)

Sei in dem ChatGPT Befehl so detailliert und spezifisch wie möglich

Je mehr Informationen du der KI zur Verfügung stellst, desto besser kann sie deine Erwartungen verstehen und effektive Texte verfassen. Achte also darauf, dass du bei deinen Aufforderungen so viele Details wie möglich angibst.

Du kannst gerne Kombinationen aus mehreren Modifikatoren verwenden.

Gleichzeitig solltest du nicht zwei entgegengesetzte Modifikatoren wie kurz und lang in einer Aufforderung verwenden.

Biete Kontext an

Genau wie Menschen kann auch die KI besser mit Kontext umgehen. Überlege dir genau, was die KI generieren soll, und biete einen Prompt an, der genau darauf zugeschnitten ist und verwende dabei die oben angesprochenen Modifikatoren..

Hier sind ein paar Beispiele, wie du eine Eingabeaufforderung verbessern kannst, indem du mehr Kontext hinzufügst:

Einfacher Prompt: „Schreibe über Produktivität.“

Besserer Prompt: „Schreibe einen Blogbeitrag über die Bedeutung der Produktivität für kleine Unternehmen.“

Wenn du die Art des Inhalts („Blog“) und einige Details darüber angibst, worum es in dem Blogbeitrag gehen soll, wird der Roboter viel hilfreicher sein.

Hier ist ein weiteres Beispiel, dieses Mal mit anderen Details.

Einfacher Prompt: „Schreibe darüber, wie man einen Hund stubenrein macht.“

Besserer Prompt: „Schreibe als professioneller Hundetrainer eine E-Mail an einen Kunden, der einen neuen, drei Monate alten Corgi hat, über die Aktivitäten, die er durchführen sollte, um seinen Welpen stubenrein zu machen.“

In dem besseren Prompt fordere ich die KI auf, eine bestimmte Rolle einzunehmen („Hundetrainer“), und wir bieten einen spezifischen Kontext rund um das Alter und die Art des Hundes. Außerdem sagen wir ihr, wie im vorherigen Beispiel, welche Art von Inhalt wir wollen („E-Mail“).

Die KI kann auch den Schreibstil der Ausgabe ändern, also achte darauf, dass du diesen Kontext mit einbeziehst, wenn er für deinen Anwendungsfall wichtig ist.

Einfacher Prompt: „Schreibe ein Gedicht über fallende Blätter.“

Verbesserter Prompt: „Schreibe ein Gedicht im Stil von Edgar Allan Poe über fallende Blätter“.

Diese Aufforderung kann auch für alle möglichen geschäftlichen Aufgaben verwendet werden, z. B. „Schreibe eine professionelle, aber freundliche E-Mail“ oder „Schreibe eine formelle Zusammenfassung“.

ChatGPT Trick: „Handle als <Jemand>“

Mit diesem Prompt-Stil im rahmend er ChatGPT Tipps und Tricks, kannst du ChatGPT dazu bringen, als jemand anderes zu agieren.

Hier sind zum Beispiel einige Prompts:

Handle als Englisch-Übersetzer und -Korrektor Prompt:

Ich möchte, dass du als Englisch-Übersetzer, Rechtschreibkorrektor und -Verbesserer auftrittst. Ich spreche zu dir in einer beliebigen Sprache und du sollst die Sprache erkennen, sie übersetzen und in der korrigierten und verbesserten Version meines Textes auf Deutsch antworten. Ich möchte, dass du meine vereinfachten Wörter und Sätze durch schönere und elegantere deutsche Wörter und Sätze auf höherem Niveau ersetzt. Behalte die Bedeutung bei, aber mache sie literarischer. Ich möchte, dass du nur die Korrekturen und Verbesserungen beantwortest, aber keine Erklärungen schreibst. Mein erster Satz ist „Comment ca va? „

Schauspielere als ‚Charakter‘ aus ‚Film/Buch/irgendwas‘:

Ich möchte, dass du dich wie {Charakter} aus {Serie} verhältst. Ich möchte, dass du wie {Charakter} reagierst und antwortest, indem du den Tonfall, die Art und Weise und das Vokabular benutzt, die {Charakter} benutzen würde. Schreibe keine Erklärungen. Antworte nur wie {Charakter}. Du musst das gesamte Wissen von {Charakter} kennen. Der erste Satz lautet: „Hallo {Charakter}.“

Beispiele : Charakter: Harry Potter, Serie: Harry-Potter-Reihe, Figur: Darth Vader, Serie: Star Wars usw.

Handle wie ein Geschichtenerzähler:

Ich möchte, dass du als Geschichtenerzähler/in agierst. Du sollst dir unterhaltsame Geschichten ausdenken, die das Publikum fesseln, phantasievoll und mitreißend sind. Das können Märchen, Bildungsgeschichten oder jede andere Art von Geschichte sein, die das Potenzial hat, die Aufmerksamkeit und Fantasie der Menschen zu fesseln. Je nach Zielgruppe kannst du bestimmte Themen für deine Märchenstunde wählen, z.B. für Kinder kannst du über Tiere sprechen, für Erwachsene eignen sich Geschichten aus der Geschichte besser usw. Meine erste Anfrage lautet:

„Ich brauche eine interessante Geschichte über Durchhaltevermögen.“

Auftreten als Werbetreibender:

Ich möchte, dass du als Werbetreibender agierst. Du wirst eine Kampagne erstellen, um ein Produkt oder eine Dienstleistung deiner Wahl zu bewerben. Du wählst eine Zielgruppe aus, entwickelst Schlüsselbotschaften und Slogans, wählst die Medienkanäle für die Werbung aus und entscheidest über zusätzliche Aktivitäten, die zum Erreichen deiner Ziele notwendig sind. Mein erster Vorschlag lautet:

„Ich brauche Hilfe bei der Erstellung einer Werbekampagne für eine neue Art von Energydrink, die sich an junge Erwachsene zwischen 18 und 30 Jahren richtet. „

Auftritt als Drehbuchautor

Ich möchte, dass du als Drehbuchautor/in agierst. Du wirst ein fesselndes und kreatives Drehbuch für einen Spielfilm oder eine Webserie entwickeln, das die Zuschauer/innen fesselt. Beginne damit, dir interessante Charaktere auszudenken, den Schauplatz der Geschichte, Dialoge zwischen den Charakteren usw. Wenn du die Charaktere entwickelt hast, entwickle eine spannende Geschichte mit vielen Wendungen, die die Zuschauer bis zum Ende in Atem hält. Meine erste Anfrage lautet:

„Ich muss einen romantischen Drama-Film schreiben, der in Paris spielt. „

Nützliche Informationen vorab angeben

Angenommen, du willst eine Einleitung für dich selbst schreiben: Woher soll die KI dann wissen, wer du bist? So schlau ist sie (noch) nicht. Aber du kannst ihr die Informationen geben, die sie braucht, damit sie sie direkt referenzieren kann. Du könntest z. B. deinen Lebenslauf oder dein LinkedIn-Profil kopieren und oben in deine Eingabeaufforderung einfügen, etwa so:

Claudias Lebenslauf: [füge hier den vollständigen Lebenslauf ein]

Mit diesen Informationen schreibst du eine witzige Redner-Bio über Claudia.

Ein anderer gängiger Anwendungsfall ist, die KI einen Artikel für dich zusammenfassen zu lassen. Hier ist ein Beispiel dafür, wie du OpenAIs ChatGPT dazu bringen kannst, das effektiv zu tun.

[Füge den vollständigen Text des Artikels hier ein]

Fasse den Inhalt des obigen Artikels in 5 Aufzählungspunkten zusammen.

Denke daran, dass ChatGPT nur auf Dinge zugreifen kann, die vor 2021 veröffentlicht wurden, und dass es keinen Zugang zum Internet hat. Das bedeutet, dass du nicht erwarten kannst, dass es über aktuelle Ereignisse auf dem Laufenden ist, und du kannst ihm keine URL zum Lesen geben. Auch wenn es manchmal so aussieht, als würde es funktionieren, verwendet es in Wirklichkeit nur den Text in der URL selbst (sowie sein Gedächtnis, was typischerweise auf dieser Domain zu finden ist), um eine Antwort zu generieren.

Gib Beispiele

Die Angabe von Beispielen in der Eingabeaufforderung kann der KI helfen, die Art der Antwort zu verstehen, die du erwartest (und gibt ihr noch mehr Kontext).

Wenn du zum Beispiel möchtest, dass die KI die Frage eines Nutzers in einem chatbasierten Format beantwortet, kannst du ein Beispiel für eine frühere Unterhaltung zwischen dem Nutzer und dem Agenten einfügen. Du solltest deine Eingabeaufforderung mit „Agent:“ abschließen, um anzugeben, wo die KI mit der Eingabe beginnen soll. Das kannst du zum Beispiel so machen:

Du bist ein Bäckereiexperte und beantwortest die Fragen der Nutzer. Antworte als Agent.

Gesprächsbeispiel:

Nutzer: Hey, kannst du mir bei etwas helfen?

Agent: Klar! Womit brauchst du Hilfe?

Benutzer: Ich möchte einen Kuchen backen, aber ich weiß nicht, auf welche Temperatur ich den Ofen einstellen soll.

Agentin: Für die meisten Kuchen sollte der Ofen auf 177°C (350°F) vorgeheizt werden.

Aktuelle Konversation:

Benutzer: [Frage des Benutzers einfügen]

Agent:

Beispiele können auch für Mathematik, Codierung, Parsing und alles andere hilfreich sein, bei dem es auf die Details ankommt. Wenn du ChatGPT benutzen willst, um Daten für dich zu formatieren, ist es besonders wichtig, ihm ein Beispiel zu geben. Zum Beispiel so:

Beispiel:

Eingabe: 2020-08-01T15:30:00Z

Füge 3 Tage hinzu und konvertiere den folgenden Zeitstempel in das Format MMM/DD/YYYYY HH:MM:SS

Ausgabe: Aug/04/2020 15:30:00

Input: 2020-07-11T12:18:03.934Z

Ausgabe:

Gib an, wie lang die Antwort sein soll.

Es ist hilfreich, eine Wortzahl für die Antwort anzugeben, damit du nicht eine Antwort mit 500 Wörtern bekommst, obwohl du eigentlich einen Satz wolltest (oder umgekehrt). Du kannst auch eine Spanne für die zulässige Länge angeben.

Wenn du z. B. eine Antwort von 500 Wörtern möchtest, könntest du eine Aufforderung wie „Schreibe eine Zusammenfassung dieses Artikels mit 500-750 Wörtern“ geben. Das gibt der KI die Flexibilität, eine Antwort zu erstellen, die innerhalb der vorgegebenen Spanne liegt. Du kannst auch weniger präzise Begriffe wie „kurz“ oder „lang“ verwenden.

Einfacher Prompt: „Fassen Sie diesen Artikel zusammen.“

Verbesserter Prompt: „Schreibe eine Zusammenfassung mit 500 Wörtern zu diesem Artikel.“

Die richtigen ChatGPT Befehle für lange Ausgaben, damit sich ChatGPT nicht wiederholt

Damit ChatGPT eine lange Ausgabe fortsetzt, ohne sich zu wiederholen solltest Du dies beachten:

-

Bei „Fortsetzen“ wird die Ausgabe oft wiederholt.

-

Die Option „Genau dort weitermachen, wo du aufgehört hast“ funktioniert in 75 % der Fälle.

-

Fortsetzen ab „(zitiere die letzten 5 Wörter)“ funktioniert in 99 % der Fälle.

Eine weitere Lektion über die Spezifität von Prompts.

Definiere die erwarteten Formate

ChatGPT kann verschiedene Code-Sprachen wie Python und HTML sowie visuelle Formate wie Diagramme und CSV-Dateien ausgeben. Wenn du ihm das Format deiner Eingabe und deiner gewünschten Ausgabe mitteilst, bekommst du genau das, was du brauchst. Zum Beispiel:

Produktname,Menge

Apfel,1

Orange,2

Banane,1

Kiwi,1

Ananas,2

Jackfrucht,1

Apfel,2

Orange,1

Banane,1

Gib mit der obigen CSV-Datei ein Diagramm aus, in dem die Häufigkeit jedes Produkts im obigen Text angezeigt wird.

Es kann leicht passieren, dass du vergisst, das Eingabeformat (in diesem Fall CSV) zu definieren. Überprüfe also noch einmal, ob du das getan hast.

Ein anderes Beispiel: Vielleicht möchtest du das Transkript deines letzten Podcast-Interviews auf deiner Website einfügen, musst es aber in HTML umwandeln. Die KI kann das gut, aber du musst ihr genau sagen, was du brauchst.

[Füge den vollständigen Text einer Interviewabschrift ein]

Gib das obige Interview in HTML aus.

Hinterfrage das konventionelle Narrativ

Frag nach Beispielen, die dem vorherrschenden Narrativ widersprechen. Erstelle Inhalte, die die Annahmen der Leser herausfordern. Suche nach provokanten Blickwinkeln, die den Erwartungen trotzen und den Rahmen sprengen.

Beispiel für einen ChatGPT Befehl:

Thema: Dein E-Mail-Newsletter soll wachsen

Nenne zum obigen Thema Beispiele, die dem vorherrschenden Narrativ widersprechen. Erstelle eine Gliederung für Inhalte, die zum Nachdenken anregen und Annahmen in Frage stellen.

Verwende unkonventionelle ChatGPT Befehle

Versuche, ChatGPT Befehle zu verwenden, die offener oder abstrakter sind. Auf diese Weise erhältst du einzigartige und kreative Antworten, die sonst niemand erhält. Indem du dich verrückt machst, kannst du das kreative Potenzial von ChatGPT freisetzen, indem du eine lebendige Sprache und unerwartete Themen findest.

Beispiel für einen ChatGPT Prompt:

Schreibe ein Gedicht über Copywriting.

Beschreibe das Gefühl, ein Unternehmer zu sein, mit 10 Adjektiven.

Ultra-Brainstormer

Es ist einfach, ChatGPT eine Liste mit möglichen Themenideen für dein nächstes Projekt erstellen zu lassen. Aber oft sind sie zu allgemein und vorhersehbar. Fordere es stattdessen auf, ein bekanntes Thema aus neuen Blickwinkeln oder mit neuen Ansätzen zu behandeln.

Beispiel für einen ChatGPT Prompt:

Thema: Wie du deinen kreativen Output verdoppeln kannst.

Überlege dir für das oben genannte Thema neue Blickwinkel oder Ansätze. Priorisiere dabei Ideen, die ungewöhnlich oder neu sind.

Erfasse deinen Schreibstil

Füttere ChatGPT mit deinen Texten. Bitte es, dir dabei zu helfen, einen Style Guide für zukünftige Veröffentlichungen zu erstellen. Es wird dir die genauen Worte geben, um deine Stimme und deinen Tonfall so zu beschreiben, dass die KI sie versteht.

Beispiel für einen ChatGPT Befehl:

Ein PromptPersonality ist ein Absatz, der den Schreibstil und den Tonfall eines geschriebenen Textes beschreibt. Du bist PBot, der einen geschriebenen Text analysiert und eine PromptPersonality erstellt. Analysiere den folgenden Text und erstelle eine PromptPersonality:

(Artikel hier einfügen)

Füge von einem Menschen geschriebene Techniken ein

Bitte ChatGPT, nach guten Ratschlägen zu arbeiten, die du anderswo gelesen hast. In dem folgenden Chat GPT Prompt nehme ich einige Tipps zum überzeugenden Schreiben aus dem Grammarly-Blog und bitte ihn, sie auf mein Thema anzuwenden.

Beispiel für einen ChatGPT Befehl:

Schreibe einen kurzen Beitrag darüber, warum Copywriting im Jahr 2023 eine wichtige Fähigkeit ist.

Verwende diese Strategien:

-

Verwende eine überzeugende Sprache

-

Stelle Fragen zur Überleitung zwischen den Absätzen

-

Untermauere die wichtigsten Punkte mit Beweisen und Beispielen

-

Sprich direkt mit dem Leser

Lass ChatGPT aus verschiedenen Perspektiven schreiben

Bitte ChatGPT mit diesem Trick, aus der Perspektive einer Gruppe von Personen mit unterschiedlichen Hintergründen oder Standpunkten zu schreiben. Erforsche neue Ideen und Perspektiven und gib deinem Text mehr Tiefe.

Beispiel für einen ChatGPT Prompt:

Thema: Produktivität für Unternehmer

Schreibe zu dem oben genannten Thema mehrere Perspektiven aus einer Gruppe mit unterschiedlichen Standpunkten. Schreibe für jede Perspektive in ihrer eigenen Stimme und verwende Sätze, die die jeweilige Person verwenden würde.

Schreibe in verschiedenen Stilen oder Tönen, wie z.B. Satire oder Ironie.

Indem du mit verschiedenen Stimmen und Perspektiven experimentierst, kannst du mit ChatGPT dynamischere und abwechslungsreichere Inhalte erstellen.

Beispiel für einen ChatGPT Befehl:

Gib den ironischsten, satirischsten Ratschlag, den du über die Verwendung von ChatGPT geben kannst, um effektivere Inhalte zu erstellen.

Erstelle Inhalte mit einem bestimmten Zweck oder Ziel vor Augen

Sag ChatGPT, wer dein Publikum ist und was du mit deinen Inhalten erreichen willst. Denke daran, dass ChatGPT keinen Kontext darüber hat, wer du bist oder was du willst, wenn du ihm keinen Kontext gibst.

Gib ihm also einen Kontext.

Beispiel für einen ChatGPT Befehl:

Thema: Wie du dein Coaching-Geschäft ausbauen kannst Für die Zielgruppe: Business Coaches Ziel des Textes: Die Leser/innen sollen motiviert werden, ihr Geschäft auszubauen und gleichzeitig einen Tipp erhalten. Schreibstil: Klar, prägnant, gesprächig, bodenständig, bescheiden, erfahre

Spiele mit den ChatGPT Prompts

Verändere und verbessere deine ChatGPT Prompts so lange, bis du das gewünschte Ergebnis erhältst.

FAQs

Im Folgenden gehe ich auf einige häufige Fragen rund um das Thema ChatGPT Tipps und Tricks ein.

Was ist ChatGPT?

ChatGPT ist eine künstliche Intelligenz, die Unterhaltungen nachahmen und sich so mit Menschen unterhalten kann, ähnlich wie ein Chatbot.

Wie benutzt man ChatGPT?

Der wichtigste Teil der Nutzung von ChatGPT ist das Experimentieren.

Um ChatGPT zu nutzen, befolge diese einfachen Schritte:

-

Melde dich bei OpenAI an (es ist kostenlos).

-

Öffne die ChatGPT-Ansicht.

-

Sende eine Nachricht an ChatGPT.

-

Warte ein paar Sekunden.

-

Sieh dir die Antwort an.

Was sind ChatGPT Prompts bzw. ChatGPT Befehle?

Ein ChatGPT-Prompt ist eine Text-, Bild- oder Audioinformation, die als Anweisung oder Befehl für ein KI-Modell wie ChatGPT dient. Er ist das wichtigste Kommunikationsmittel zwischen dem Nutzer und dem KI-Modell und seine Struktur und sein Inhalt sind entscheidend für den Erfolg des Modells bei der Ausführung der gewünschten Aufgabe.

Was sind die verschiedenen Arten von ChatGPT-Prompts bzw. ChatGPT Befehlen?

ChatGPT-Prompts bzw. ChatGPT Befehle können viele verschiedene Formen annehmen, z. B. natürlichsprachliche Prompts, Bild-Prompts oder Audio-Prompts. Alles, was einem KI-Modell wie ChatGPT eingegeben wird und von ihm ausgegeben werden muss, ist technisch gesehen ein Prompt.

Wie wichtig sind bzw. ChatGPT Befehle bzw. Prompts bei der Erstellung von KI-Inhalten?